Обзор функций потерь в машинном обучении

Подобно тому, как учителя направляют нас, независимо от того, хорошо ли мы выступаем в наших учебных заведениях, функции потери выполняют ту же работу. Это метод оценки того, насколько хорошо наш алгоритм моделирует данные. Функции потери являются основным источником оценки в современном машинном обучении. Когда вы изменяете свой алгоритм, чтобы улучшить свою модель, значение функции потерь сообщит вам, делаете ли вы прогресс или нет. Нашей основной целью должно быть снижение функции потерь путем оптимизации. В этой статье мы собираемся обсудить, как работают функции потерь и различные типы функций потерь.

Как работают функции потери?

Слово «Потеря» устанавливает штраф за неспособность достичь ожидаемого результата. Если отклонение в прогнозируемом значении по сравнению с ожидаемым значением в нашей модели велико, то функция потерь дает большее значение в качестве выходного значения, а если отклонение мало и намного ближе к ожидаемому значению, оно выводит меньшее число.

Вот пример, когда мы пытаемся предсказать цену продажи домов в городах метро.

| предсказанный

Цена продажи (в лакхах) | фактический

Цена продажи (в лакхах) | Отклонение (Убыток) |

| Бангалор: 45 | 0 (все прогнозы верны) | |

| Пуна: 35 | ||

| Ченнаи: 40 | ||

| Бангалор: 40 | Бангалор: 45 | 5 лакх за Бангалор, 2 лакх за Ченнай |

| Пуна: 35 | Пуна: 35 | |

| Ченнаи: 38 | Ченнаи: 40 | |

| Бангалор: 43 | 2 лакха для Бангалора, 5 лакхов для Пуна2 лакха для Ченнаи, | |

| Пуна: 30 | ||

| Ченнаи: 45 |

Важно отметить, что величина отклонения не имеет значения, здесь важно то, является ли значение, предсказанное нашей моделью, правильным или неправильным. Функции потерь различаются в зависимости от вашей задачи, к которой применяется машинное обучение. Функция стоимости - это еще один термин, который используется взаимозаменяемо для функции потерь, но имеет немного другое значение. Функция потерь предназначена для отдельного примера обучения, а функция затрат - это средняя потеря по всему набору данных поезда.

Типы функций потерь в машинном обучении

Ниже приведены различные типы функции потерь в машинном обучении, которые следующие:

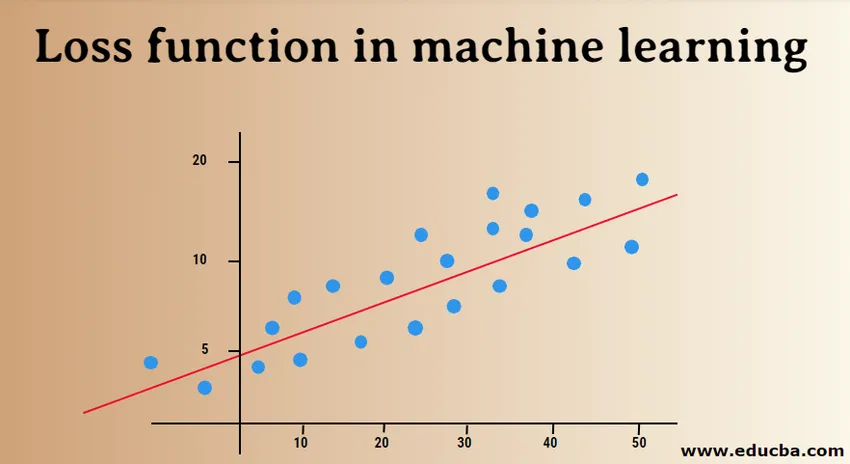

1) Функции потери регрессии:

Линейная регрессия является фундаментальной концепцией этой функции. Функции потери регрессии устанавливают линейную связь между зависимой переменной (Y) и независимой переменной (X), поэтому мы пытаемся подобрать наилучшую линию в пространстве для этих переменных.

Y = X0 + X1 + X2 + X3 + X4…. + Xn

X = независимые переменные

Y = зависимая переменная

- Средняя квадратичная ошибка:

MSE (ошибка L2) измеряет среднеквадратичную разницу между фактическим и прогнозируемым значениями по модели. Выход представляет собой одно число, связанное с набором значений. Наша цель - уменьшить MSE, чтобы повысить точность модели.

Рассмотрим линейное уравнение, y = mx + c, мы можем вывести MSE как:

MSE = 1 / N ∑i = 1 до n (y (i) - (mx (i) + b)) 2

Здесь N - общее количество точек данных, 1 / N i = 1 до n - среднее значение, а y (i) - фактическое значение, а mx (i) + b - его прогнозируемое значение.

- Среднее квадратичное логарифмическая потеря ошибки (MSLE):

MSLE измеряет соотношение между фактическим и прогнозируемым значением. Это вводит асимметрию в кривую ошибки. MSLE заботится только о процентной разнице фактических и прогнозируемых значений. Это может быть хорошим выбором в качестве функции потерь, когда мы хотим предсказать цены продажи домов, цены продажи хлебобулочных изделий и данные непрерывны.

Здесь потери могут быть рассчитаны как среднее из наблюдаемых данных квадратов разностей между логически преобразованными фактическими и прогнозными значениями, которые могут быть заданы как:

L = 1nnΣi = 1 (лог (у (я) + 1) -log (у (я) + 1)) 2

- Средняя абсолютная ошибка (MAE):

MAE рассчитывает сумму абсолютных различий между фактическими и прогнозируемыми переменными. Это означает, что он измеряет среднюю величину ошибок в наборе прогнозируемых значений. Использовать среднеквадратическую ошибку легче, но абсолютную ошибку более устойчиво к выбросам. Выбросы - это те значения, которые сильно отличаются от других наблюдаемых точек данных.

MAE можно рассчитать как:

L = 1nnΣi = 1||y (я) - у (я) ||

2) Функции потери двоичной классификации:

Эти функции потерь предназначены для измерения характеристик модели классификации. При этом точкам данных присваивается одна из меток, т. Е. Либо 0, либо 1. Далее их можно классифицировать как:

- Двоичная кросс-энтропия

Это функция потерь по умолчанию для задач двоичной классификации. Кросс-энтропийная потеря вычисляет производительность классификационной модели, которая дает выходное значение вероятности в диапазоне от 0 до 1. Кросс-энтропийная потеря увеличивается, когда прогнозируемое значение вероятности отклоняется от фактической метки.

- Потеря шарнира

Потеря шарнира может быть использована в качестве альтернативы кросс-энтропии, которая изначально была разработана для использования с алгоритмом машины опорных векторов. Потеря шарнира лучше всего работает с проблемой классификации, поскольку целевые значения находятся в наборе (-1, 1). Это позволяет назначить больше ошибок, когда есть разница в знаке между фактическими и прогнозируемыми значениями. Следовательно, это приводит к лучшей производительности, чем кросс-энтропия.

- Квадратная потеря шарнира

Расширение потери шарнира, которое просто вычисляет квадрат показателя потери шарнира. Это уменьшает функцию ошибок и упрощает работу с ней. Он находит границу классификации, которая определяет максимальный запас между точками данных различных классов. Квадратная потеря шарнира идеально подходит для ДА ИЛИ НЕТ решения проблем, где отклонение вероятности не является проблемой.

3) Функции потери мультиклассовой классификации:

Многоклассовая классификация - это прогностические модели, в которых точки данных назначаются более чем двум классам. Каждому классу присваивается уникальное значение от 0 до (Number_of_classes - 1). Настоятельно рекомендуется для задач классификации изображений или текста, когда одна статья может иметь несколько тем.

- Мультиклассовая кросс-энтропия

В этом случае целевые значения находятся в диапазоне от 0 до n, т.е. (0, 1, 2, 3… n). Он рассчитывает оценку, которая принимает среднюю разницу между фактическими и прогнозируемыми значениями вероятности, и оценка минимизируется для достижения максимально возможной точности. Мультиклассовая кросс-энтропия является функцией потерь по умолчанию для задач классификации текста.

- Разреженная мультиклассовая кросс-энтропия

Один горячий процесс кодирования делает мульти-классовую перекрестную энтропию трудной для обработки большого количества точек данных. Разреженная кросс-энтропия решает эту проблему, выполняя расчет ошибки без использования горячего кодирования.

- Потеря дивергенции Кулбека Лейблера

Потеря дивергенции KL вычисляет расхождение между распределением вероятностей и базовым распределением и определяет, сколько информации теряется в битах. Выходное значение является неотрицательным значением, которое указывает, насколько близки два вероятностных распределения. Чтобы описать дивергенцию KL с точки зрения вероятностного представления, используется отношение правдоподобия.

Изначально в этой статье мы поняли, как работают функции потерь, а затем приступили к изучению исчерпывающего списка функций потерь с примерами использования. Однако, понимание этого на практике является более полезным, поэтому постарайтесь больше читать и применять его. Это прояснит ваши сомнения полностью.

Рекомендуемые статьи

Это руководство по функциям потери в машинном обучении. Здесь мы обсуждаем, как работают функции потерь и типы функций потерь в машинном обучении. Вы также можете взглянуть на следующие статьи, чтобы узнать больше -

- Методы машинного обучения

- Введение в машинное обучение

- Технологии больших данных

- Big Data Analytics Software

- Изучите категории гиперпараметров

- Жизненный цикл машинного обучения | 8 лучших этапов