Различия между Кафкой и Искрой

Организации постоянно растут с огромными данными. Они пытаются использовать Hadoop для таких огромных данных вместо традиционных СУБД. В то же время они хотят быстрой обработки и вывода в реальном времени. Hadoop - это платформа с открытым исходным кодом, где мы можем использовать несколько языков для различных типов инструментов, таких как Python, Scala. Для обработки в реальном времени в Hadoop мы можем использовать Kafka и Spark. Это небольшая статья, в которой я пытаюсь объяснить, как будет работать Kafka vs Spark.

Кафка

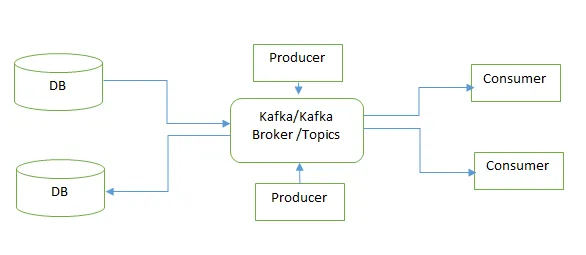

Kafka - это платформа обработки потоков с открытым исходным кодом, разработанная Apache. Он является посредником между источником и местом назначения для потокового процесса в реальном времени, где мы можем сохранять данные в течение определенного периода времени. Kafka - это распределенная система обмена сообщениями. Где мы можем использовать эти постоянные данные для процесса в реальном времени. Он работает как служба на одном или нескольких серверах. Кафка хранит поток записей в категориях, называемых темами. Каждая запись потока состоит из ключа, значения и отметки времени.

Запустить сервер Kafka

>bin/Kafka-server-start.sh config/server.properties

Ниже приведены основные компоненты Кафки

Источник: Это сработает, когда новый источник CDC (изменение данных) или новая вставка происходит в источнике. Для этого мы должны определить ключевой столбец, чтобы идентифицировать изменение.

Брокер: который отвечает за хранение данных. Каждый брокер не имеет раздела.

Тема: Он классифицирует данные. Темы в Kafka всегда подписываются несколькими потребителями, которые подписываются на записанные в него данные.

Создать тему

> bin/kafka-topics.sh --create --zookeeper localhost:2181 --replication-factor 1 --partitions 1 --topic test

И увидеть список тем

> bin/kafka-topics.sh --list --zookeeper localhost:2181

Раздел: Темы далее разделяются на разделы для параллельной обработки.

Производитель: производитель отвечает за публикацию данных. Это подтолкнет данные к темам по их выбору. Производитель выберет, какую запись назначить тому или иному разделу в теме.

Кафка приказал создать сообщение к теме.

> bin/Kafka-console-producer.sh --broker-list localhost:9092 --topic test

Привет доброе утро

Это тестовое сообщение.

Потребитель: потребители будут потреблять данные из тем. Потребитель будет меткой со своей группой потребителей. Если в одной и той же теме есть несколько потребителей из разных групп потребителей, то каждая копия отправляется каждой группе потребителей.

Вы можете использовать несколько источников для сохранения данных. Кафка приказал потреблять сообщения к теме.

> bin/Kafka-console-consumer.sh --bootstrap-server localhost:9092 --topic test --from-beginning

Привет доброе утро

Это тестовое сообщение.

Flume: мы можем использовать Flume Kafka Sink. В котором, как только любой CDC (Change Data Capture) или New insert flume запустит запись и отправит данные в тему Кафки. Для этого мы должны установить канал.

Так же, как и у Кафки, у нас может быть HDFS, JDBC-источник и сток.

Kafka обладает лучшей пропускной способностью и имеет такие функции, как встроенное разбиение на разделы, репликация и отказоустойчивость, что делает ее лучшим решением для крупномасштабных приложений обработки сообщений или потоковых данных.

искра

Apache Spark - это инфраструктура кластерных вычислений с открытым исходным кодом. Первоначально разработанная в Калифорнийском университете в Беркли Amp Lab, кодовая база Spark была позже передана Apache Software Foundation. Spark предоставляет интерфейс для программирования целых кластеров с неявным параллелизмом данных и отказоустойчивостью.

Когда был представлен Hadoop, Map-Reduce был базовым механизмом выполнения любой задачи. В Map-Reduce выполнение (чтение - запись) происходило на реальном жестком диске. Это является причиной большего расхода времени и пространства во время выполнения.

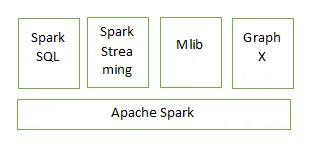

Apache Spark - это платформа с открытым исходным кодом. Улучшает качество исполнения, чем процесс Map-Reduce. Это открытая платформа, где вы можете использовать несколько языков программирования, таких как Java, Python, Scala, R. Spark обеспечивает выполнение в памяти в 100 раз быстрее, чем MapReduce. Это использует определение RDD. СДР - это надежный распределенный набор данных, который позволяет прозрачно хранить данные в памяти и сохранять их на диске только по мере необходимости. Вот где время доступа к данным из памяти вместо диска истекло.

Spark - это платформа, на которой мы можем хранить данные в Data Frame и обрабатывать их. Разработчик приложений, Data Scientist, Data Analyst может использовать Spark для обработки огромного количества данных в течение минимального периода времени. Мы можем использовать такую функцию, как интерактивный, итеративный анализ данных в Spark.

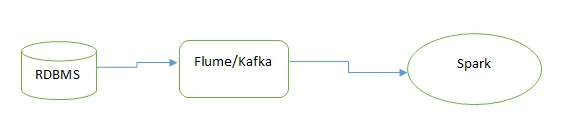

Spark Streaming - еще одна особенность, где мы можем обрабатывать данные в режиме реального времени. Банковский домен должен отслеживать транзакцию в реальном времени, чтобы предложить клиенту выгодную сделку, отслеживая подозрительные транзакции. Потоковая передача Spark наиболее популярна в молодом поколении Hadoop. Spark - это простой в разработке API, который поможет разработчику быстро работать с потоковыми проектами. Spark Streaming легко восстановит потерянные данные и сможет доставить точно, как только архитектура будет на месте. И без каких-либо дополнительных усилий в области кодирования. Мы можем одновременно работать с потоковой передачей искр и историческими пакетными данными (Lambda Architecture)

В потоковой передаче Spark мы можем использовать несколько инструментов, таких как Flume, Kafka, RDBMS в качестве источника или приемника.

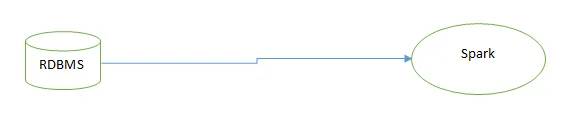

Или мы можем напрямую передавать из RDBMS в Spark.

Мы можем запустить искру поверх HDFS или без HDFS. Вот почему все говорят о его замене Hadoop. HDFS - это базовая файловая система для Hadoop. Мы можем использовать HDFS в качестве источника или цели.

Используя Spark SQL, используйте базовые SQL-запросы для обработки данных. Эта искра предоставляет улучшенные функции, такие как Mlib (Библиотека машинного обучения) для специалистов по прогнозированию данных.

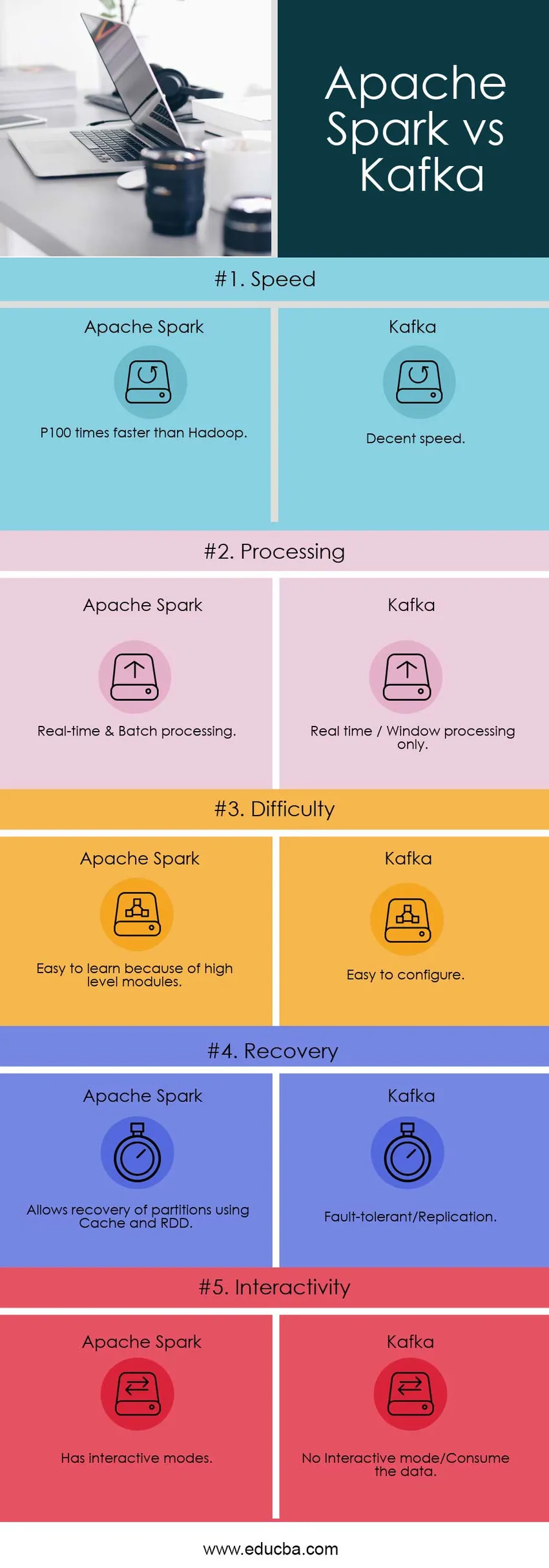

Сравнение «один на один» между Кафкой и Спарком (Инфографика)

Ниже приведено 5 лучших сравнений между Kafka и Spark.

Ключевая разница между Kafka и Spark

Давайте обсудим некоторые основные различия между Kafka и Spark:

- Кафка является брокером сообщений. Spark - это платформа с открытым исходным кодом.

- У Кафки есть Producer, Consumer, Topic для работы с данными. Там, где Spark предоставляет платформу, извлекает данные, удерживает их, обрабатывает и передает от источника к цели.

- Кафка обеспечивает потоковую передачу в реальном времени, процесс окна. Где Spark учитывает как поток в реальном времени, так и пакетный процесс.

- В Кафке мы не можем выполнить преобразование. Где в Spark мы выполняем ETL

- Kafka не поддерживает какой-либо язык программирования для преобразования данных. Где spark поддерживает несколько языков программирования и библиотек.

- Таким образом, Kafka используется для потоковой передачи в реальном времени в качестве канала или посредника между источником и целью. Где Spark использует поток в реальном времени, пакетный процесс и ETL.

Особенности игры Кафка против Спарк

Есть несколько ключевых особенностей:

- Поток данных: Kafka vs Spark обеспечивает потоковую передачу данных в режиме реального времени от источника к цели. Кафка просто поток данных к теме, Spark это процедурный поток данных.

- Обработка данных: Мы не можем выполнять какие-либо преобразования данных, в которых Spark мы можем преобразовывать данные.

- Постоянство данных: Кафка сохраняет данные до определенного времени, как определено в конфигурации. Мы должны использовать фрейм данных или объект набора данных для сохранения данных.

- Преобразование ETL: Используя Spark, мы можем выполнить ETL, где Kafka не предоставляет ETL.

- Управление памятью: Spark использует RDD для хранения данных распределенным способом (например, кеш, локальное пространство), где Kafka хранит данные в теме, то есть в буферной памяти.

Сравнительная таблица между Kafka и Spark

Ниже приведено самое лучшее сравнение между Kafka и Spark:

| Критерии характеристик | Apache Spark | Кафка |

| скорость | В 100 раз быстрее, чем Hadoop | Достойная скорость |

| обработка | В режиме реального времени и пакетной обработки | Только в режиме реального времени / обработка окон |

| трудность | Легко учиться благодаря модулям высокого уровня | Прост в настройке |

| восстановление | Позволяет восстановить разделы с использованием Cache и RDD | Отказоустойчивые / Репликация |

| интерактивность | Имеет интерактивные режимы | Нет интерактивного режима / потреблять данные |

Вывод

Мы можем использовать Кафку в качестве брокера сообщений. Он может сохранять данные за определенный период времени. Используя Kafka, мы можем выполнять операции с окнами в реальном времени. Но мы не можем выполнить преобразование ETL в Kafka. Используя Spark, мы можем сохранить данные в объекте данных и выполнить сквозные преобразования ETL.

Так что это лучшее решение, если мы используем Kafka в качестве потоковой платформы в реальном времени для Spark.

Рекомендуемая статья

Это было руководство к разнице между Кафкой и Спарк. Здесь мы также обсудим ключевые отличия Kafka от Spark с помощью инфографики и сравнительной таблицы. Вы также можете взглянуть на следующие статьи, чтобы узнать больше. Вы также можете посмотреть следующие статьи, чтобы узнать больше -

- Разница между Apache Kafka и Flume

- Апач Шторм против Кафки

- Apache Hadoop против Apache Spark

- Google Cloud против AWS

- Кафка против Кинезис | 5 главных отличий