Введение в классификацию нейронных сетей

Нейронные сети являются наиболее эффективным способом (да, вы правильно прочитали) для решения реальных проблем в области искусственного интеллекта. В настоящее время, это также одна из наиболее тщательно изученных областей в области компьютерных наук, когда новая форма нейронной сети была бы разработана, пока вы читаете эту статью. Существуют сотни нейронных сетей для решения проблем, характерных для разных областей. Здесь мы собираемся провести вас через различные типы базовых нейронных сетей в порядке возрастания сложности.

Различные типы основ в классификации нейронных сетей

1. Неглубокие нейронные сети (совместная фильтрация)

Нейронные сети состоят из групп Перцептрона, чтобы имитировать нейронную структуру человеческого мозга. Неглубокие нейронные сети имеют один скрытый слой персептрона. Одним из распространенных примеров неглубоких нейронных сетей является совместная фильтрация. Скрытый слой персептрона будет обучен представлять сходства между сущностями, чтобы генерировать рекомендации. Система рекомендаций в Netflix, Amazon, YouTube и т. Д. Использует версию совместной фильтрации, чтобы рекомендовать свои продукты в соответствии с интересами пользователей.

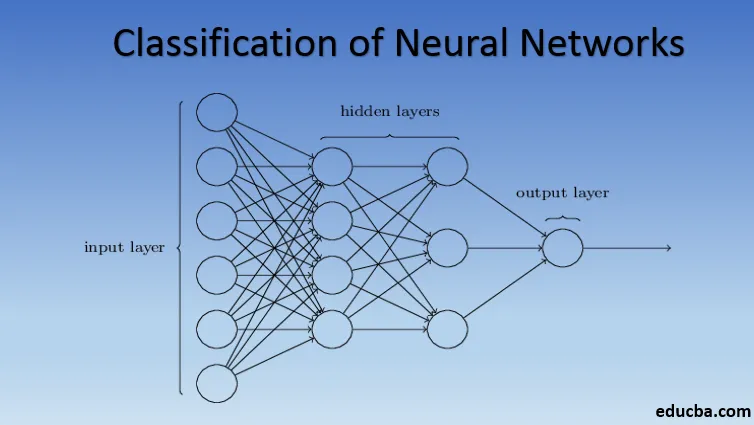

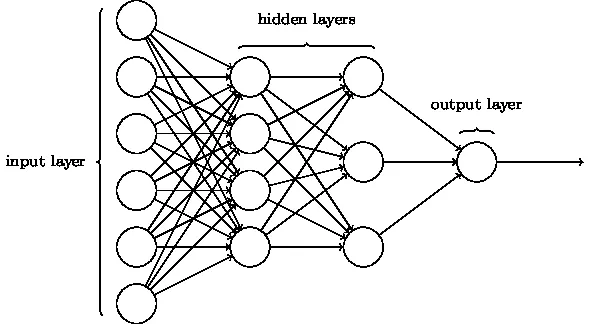

2. Многослойный персептрон (глубокие нейронные сети)

Нейронные сети с более чем одним скрытым слоем называются Deep Neural Networks. Осторожно, спойлеры! Все последующие нейронные сети являются одной из форм глубоких нейронных сетей, откорректированных / улучшенных для решения проблем, специфичных для конкретной области. В целом, они помогают нам достичь универсальности. Учитывая достаточное количество скрытых слоев нейрона, глубокая нейронная сеть может приблизиться, то есть решить любую сложную реальную проблему.

Теорема универсального приближения является ядром глубоких нейронных сетей для обучения и подгонки любой модели. Каждая версия глубокой нейронной сети состоит из полностью связанного слоя продукта с умножением матрицы, который оптимизирован алгоритмами обратного распространения. Мы продолжим изучать улучшения, приводящие к различным формам глубоких нейронных сетей.

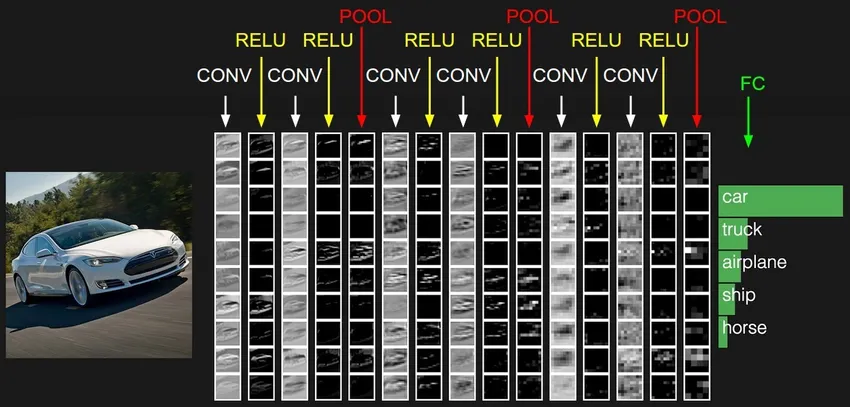

3. Сверточная нейронная сеть (CNN)

CNN являются наиболее зрелой формой глубоких нейронных сетей, которые дают наиболее точные, то есть лучшие, чем у человека, результаты в области компьютерного зрения. CNN сделаны из слоев Convolutions, созданных путем сканирования каждого пикселя изображений в наборе данных. По мере того, как данные аппроксимируются слой за слоем, CNN начинает распознавать шаблоны и тем самым распознавать объекты на изображениях. Эти объекты широко используются в различных приложениях для идентификации, классификации и т. Д. Недавние практики, такие как трансферное обучение в CNN, привели к значительным улучшениям в неточности моделей. Google Translator и Google Lens - это самые современные образцы CNN.

Применение CNN является экспоненциальным, поскольку они даже используются для решения проблем, которые в первую очередь не связаны с компьютерным зрением. Очень простое, но интуитивное объяснение CNN можно найти здесь.

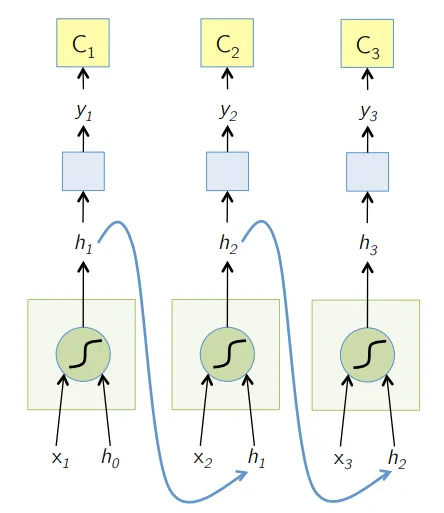

4. Рекуррентная нейронная сеть (RNN)

RNNs являются самой последней формой глубоких нейронных сетей для решения проблем в NLP. Проще говоря, сети RNN направляют выходные данные нескольких скрытых слоев обратно на входной слой для агрегирования и переноса аппроксимации на следующую итерацию (эпоху) входного набора данных. Это также помогает модели самообучаться и быстрее корректирует прогнозы. Такие модели очень полезны для понимания семантики текста в операциях НЛП. Существуют различные варианты RNN, такие как долговременная кратковременная память (LSTM), стробируемый рекуррентный блок (GRU) и т. Д. На приведенной ниже схеме активация от h1 и h2 подается на входы x2 и x3 соответственно.

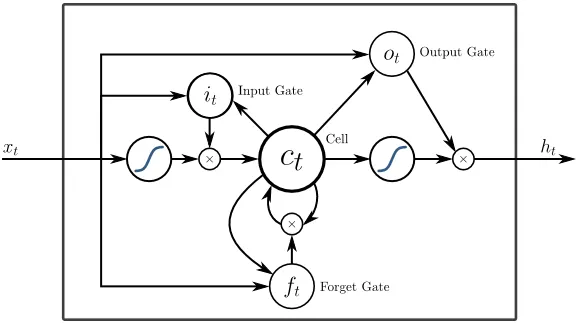

5. Долгосрочная кратковременная память (LSTM)

LSTM разработаны специально для решения проблемы исчезающих градиентов с RNN. Исчезающие градиенты случаются с большими нейронными сетями, где градиенты функций потерь имеют тенденцию приближаться к нулю, заставляя нейронные сети останавливаться для обучения. LSTM решает эту проблему, предотвращая активацию функций в своих повторяющихся компонентах и не изменяя сохраненные значения. Это небольшое изменение дало большие улучшения в окончательной модели, в результате чего технологические гиганты адаптировали LSTM в своих решениях. Перейдем к «самой простой и понятной» иллюстрации LSTM,

6. Внимание сети

Модели внимания постепенно вытесняют даже новые RNN на практике. Модели Attention построены на том, что фокусируются на части подмножества информации, которую они дают, тем самым устраняя подавляющее количество исходной информации, которая не нужна для выполняемой задачи. Модели внимания построены с сочетанием мягкого и жесткого внимания и подгонки путем обратного распространения мягкого внимания. Множество моделей внимания, уложенных иерархически, называется Transformer. Эти трансформаторы более эффективны для параллельной работы стеков, так что они дают самые современные результаты со сравнительно меньшими данными и временем для обучения модели. Распределение внимания становится очень мощным при использовании с CNN / RNN и может создавать текстовое описание изображения следующим образом.

Технические гиганты, такие как Google, Facebook и т. Д., Быстро адаптируют модели внимания для построения своих решений.

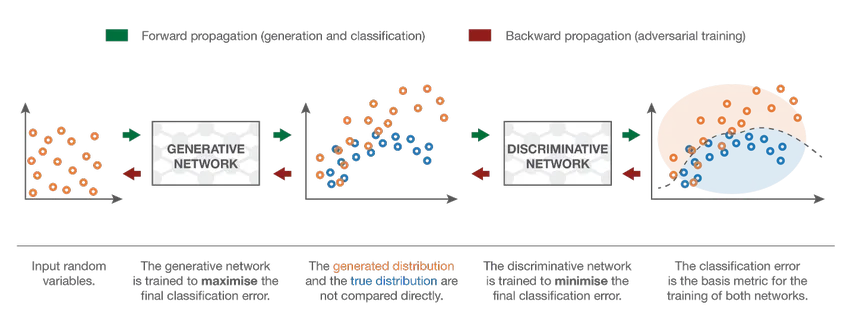

7. Генеративная Состязательная Сеть (ГАН)

Хотя модели глубокого обучения обеспечивают самые современные результаты, их могут одурачить гораздо более интеллектуальные люди, добавив шум к данным реального мира. GAN - это новейшая разработка в области глубокого обучения для решения таких сценариев. GAN используют неконтролируемое обучение, когда глубокие нейронные сети обучаются с использованием данных, сгенерированных моделью AI, а также фактического набора данных, чтобы повысить точность и эффективность модели. Эти состязательные данные в основном используются, чтобы обмануть дискриминационную модель, чтобы построить оптимальную модель. Получающаяся модель имеет тенденцию быть лучшим приближением, чем может преодолеть такой шум. Исследовательский интерес к GAN привел к появлению более сложных реализаций, таких как условная GAN (CGAN), лапландская пирамида GAN (LAPGAN), суперразрешение GAN (SRGAN) и т. Д.

Заключение - классификация нейронной сети

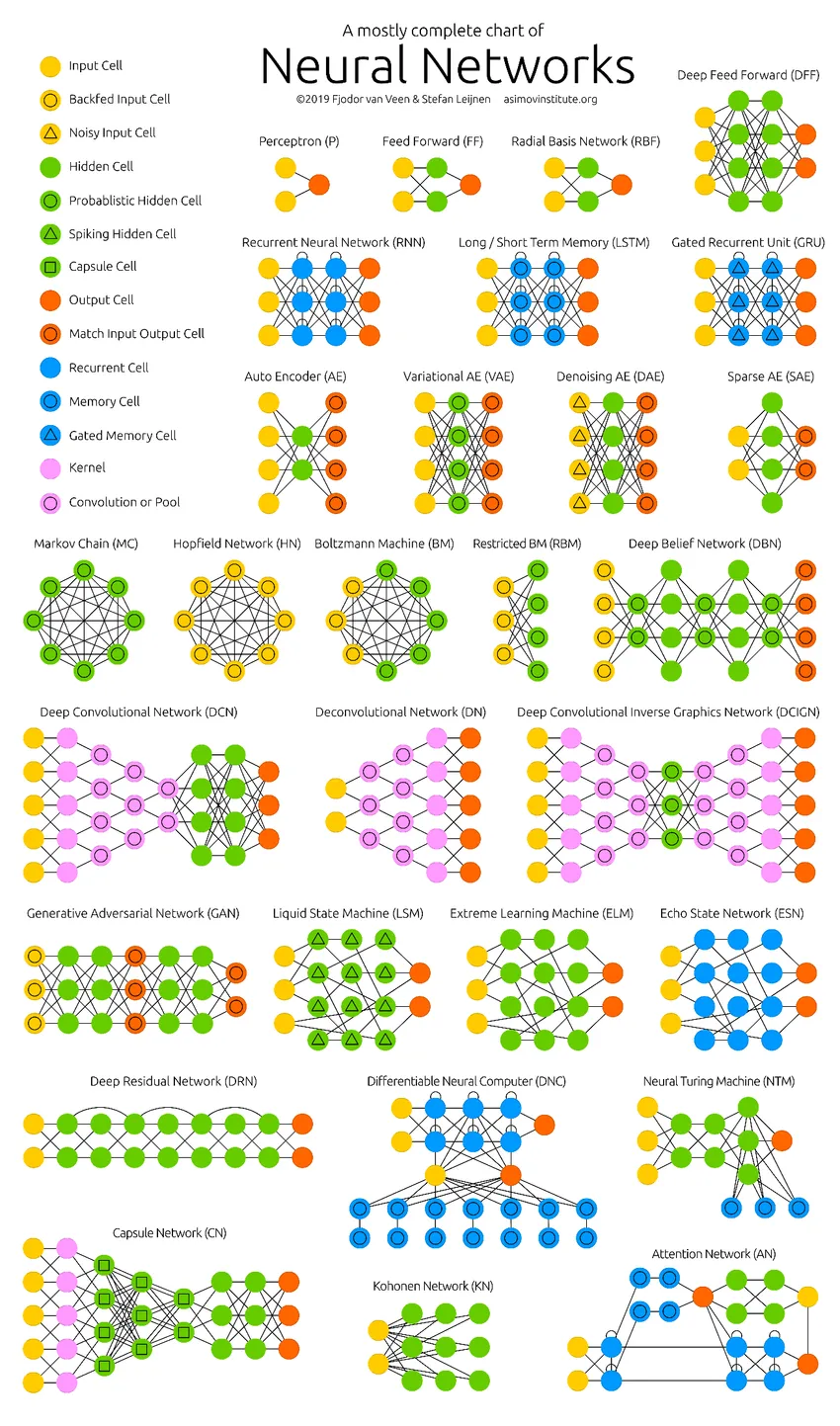

Глубокие нейронные сети раздвигают границы компьютеров. Они не ограничиваются только классификацией (CNN, RNN) или прогнозами (совместная фильтрация), но даже генерацией данных (GAN). Эти данные могут варьироваться от красивой формы искусства до спорных глубоких подделок, но они каждый день превосходят людей своей задачей. Следовательно, мы должны также учитывать этику ИИ и их влияние, одновременно работая над созданием эффективной модели нейронной сети. Время для аккуратной инфографики о нейронных сетях.

Рекомендуемые статьи

Это руководство по классификации нейронных сетей. Здесь мы обсудили различные типы базовых нейронных сетей. Вы также можете просмотреть наши статьи, чтобы узнать больше

- Что такое нейронные сети?

- Алгоритмы нейронной сети

- Инструменты сетевого сканирования

- Рекуррентные нейронные сети (RNN)

- Лучшие 6 Сравнений между CNN против RNN